Canal大数据实时数据采集工具零基础入门到实战

还在为数据同步头疼吗?面对Redis、Elasticsearch等异构数据源,如何实现毫秒级的实时同步,同时保证业务代码的纯粹与高效?今天,我们就来彻底攻克这个难题!

直面痛点:数据同步,何以解忧?在现代系统架构中,为了提升搜索性能与精准度,我们广泛引入Redis、Elasticsearch等组件。随即,一个核心挑战浮出水面:如何将数据库中的实时变化,无缝、高效地同步到这些外部存储中?

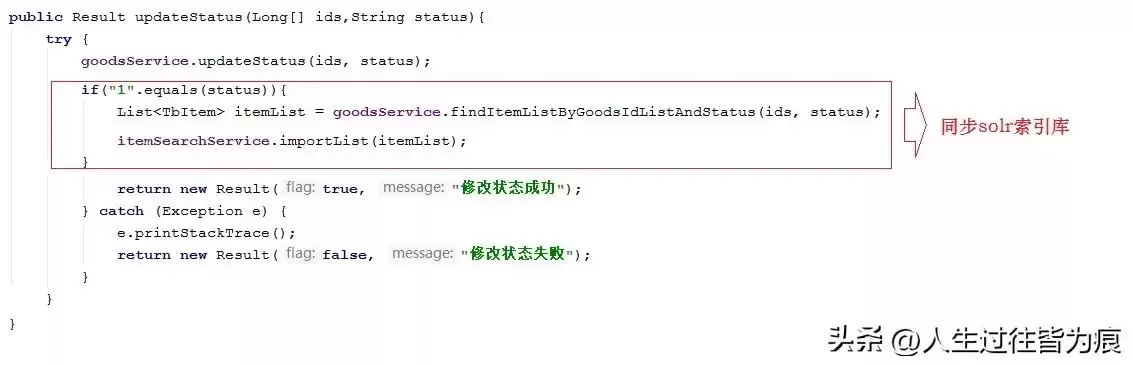

在增删改业务逻辑后,直接写入同步至Solr或Redis的代码。

优点:上手快,逻辑直观。

致命缺点:

1. 业务严重耦合:同步逻辑侵入核心业务代码。

2. 性能瓶颈:同步操作阻塞主流程,拖慢接口响应。

通过Spring Task或Quartz等定时任务,周期性扫描数据库变更并同步。

优点:与业务代码完全解耦。

核心短板:数据实时性差,依赖任务执行间隔,可能导致分钟级延迟。

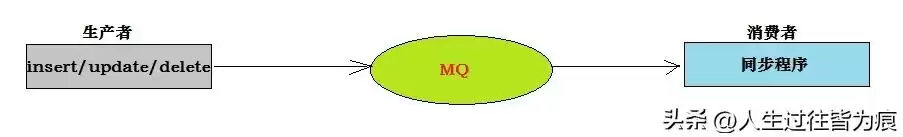

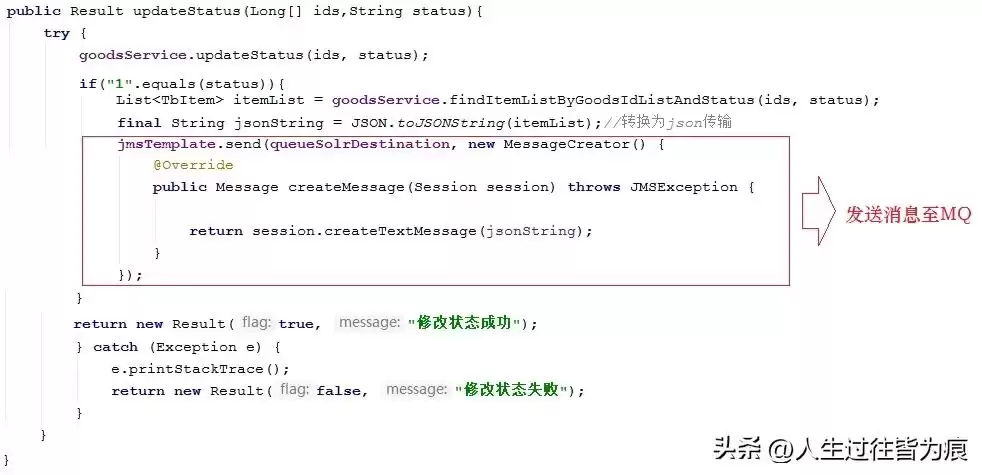

方案三:通过MQ实现同步(准实时但仍有依赖)业务代码向消息队列(如RocketMQ、Kafka)发送消息,由独立的消费者程序完成同步。

优点:业务解耦,能做到秒级准实时同步。

遗留问题:仍需在业务代码中耦合MQ发送API,并非彻底的无侵入。

方案四:通过Canal实现实时同步(终极优雅解)让Canal伪装成MySQL的从库,直接解析数据库二进制日志(Binlog),捕获数据变更,再同步到下游。这是目前最优雅、最彻底的解决方案。

核心优势:

✅ 业务代码完全解耦,零侵入。

✅ API完全解耦,无需修改任何业务逻辑。

✅ 实现毫秒级准实时同步。

✅ 无缺点,堪称完美。

Canal [kə’næl],意为水道/管道,是阿里巴巴开源的纯Java组件。它基于数据库增量日志解析,提供高性能的增量数据订阅与消费,目前是MySQL领域的事实标准。

快速开始:Canal下载与环境搭建官网:https://github.com/alibaba/canal

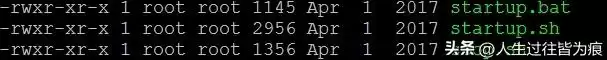

我们以1.0.24版本为例,主要使用`canal.deployer-1.0.24.tar.gz`服务端部署包。

原理:

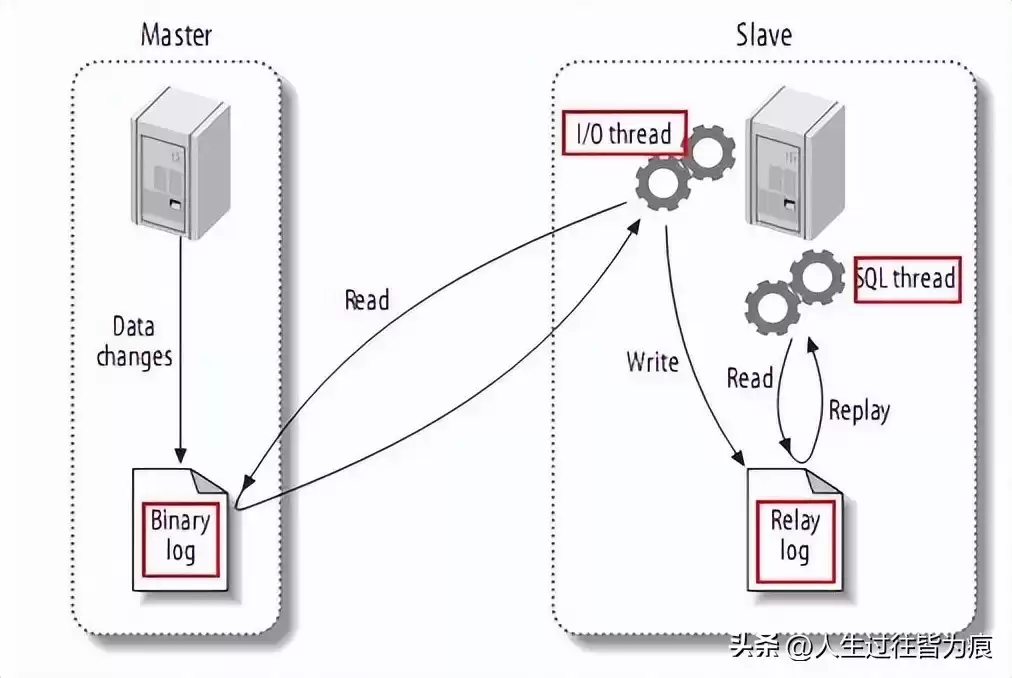

主从复制三步走:

1. Master写Binlog:主库将数据变更事件写入二进制日志。

2. Slave读Relay Log:从库请求主库的Binlog事件,写入本地中继日志。

3. Slave重放:从库重做中继日志中的事件,实现数据同步。

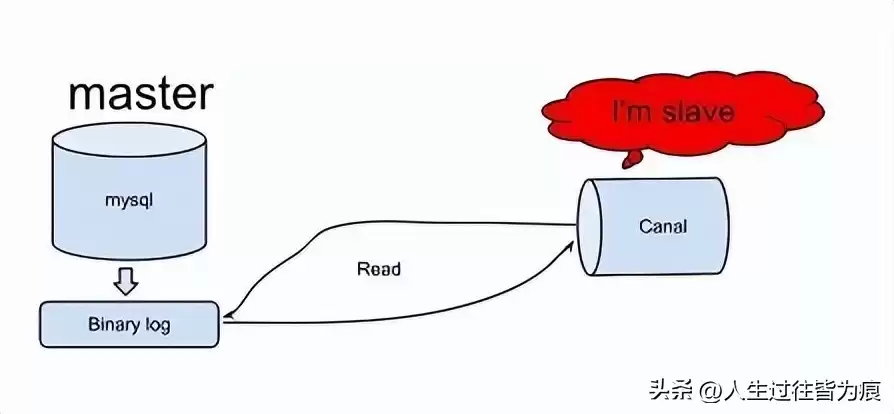

Canal的核心思路极其巧妙:把自己伪装成一个MySQL从库(Slave)。

工作流程:

1. Canal向MySQL Master发送一个`dump`请求,宣告自己是一个“从库”。

2. Master信以为真,开始持续向Canal推送二进制日志流。

3. Canal接收并解析这些二进制日志,将其转换为易于处理的数据变更对象。

核心概念:

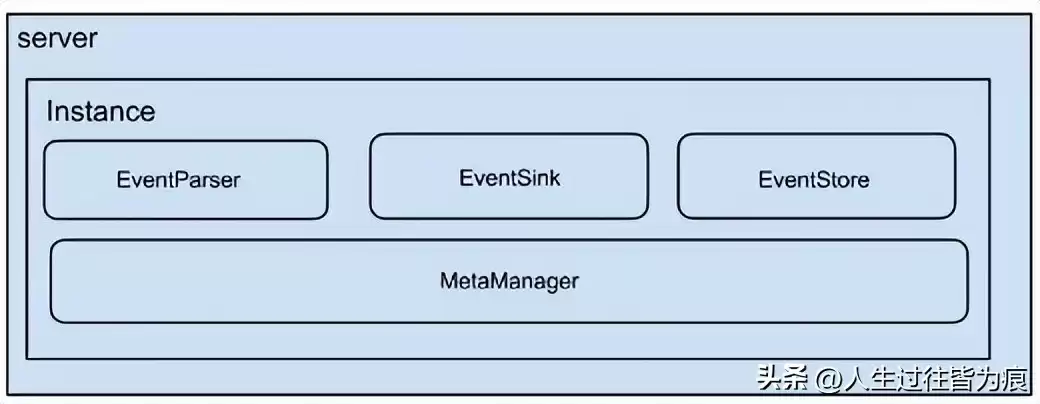

- Server:一个Canal运行实例,对应一个JVM进程。

- Instance:一个数据同步队列,一个Server可配置多个Instance。

Instance四大核心模块:

1. EventParser:数据源接入,伪装Slave与Master交互,负责协议解析。

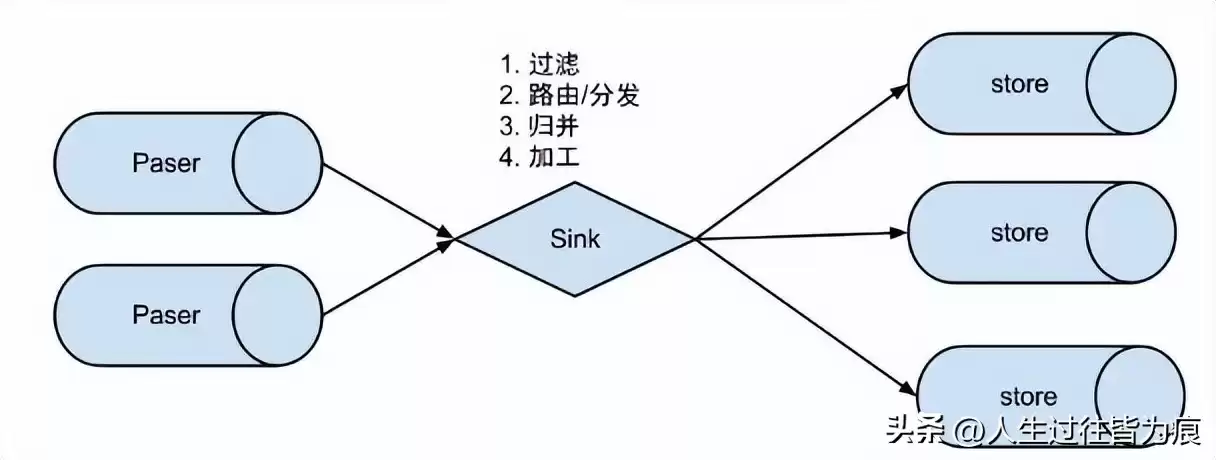

2. EventSink:连接Parser和Store的管道,负责数据过滤、加工与分发。

3. EventStore:数据存储中心。

4. MetaManager:增量订阅与消费信息的元数据管理器。

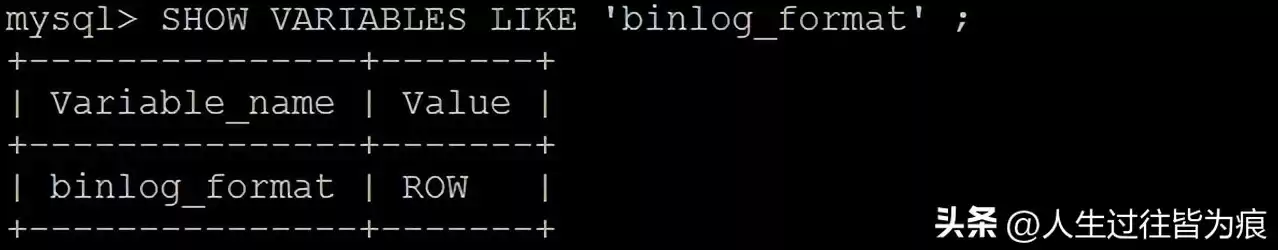

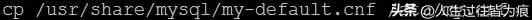

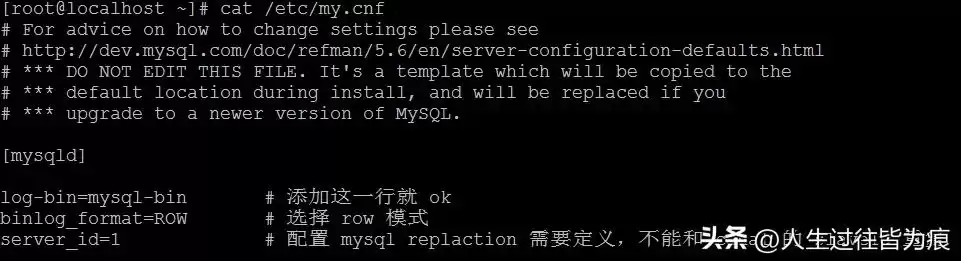

Canal依赖MySQL的Row格式Binlog。检查并修改MySQL配置文件(如my.cnf):

确保包含以下配置:

[mysqld] log-bin=mysql-bin binlog-format=ROW server-id=1

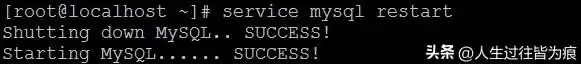

修改后务必重启MySQL服务。

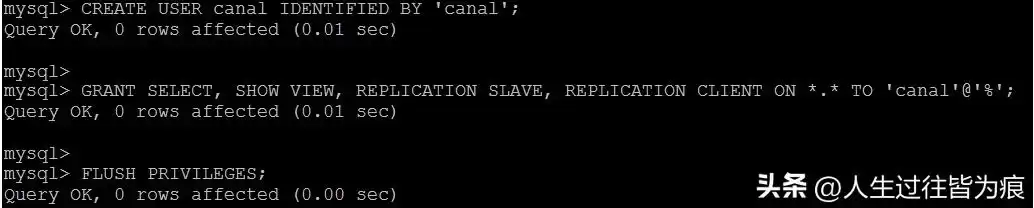

Canal需要以从库身份读取Binlog,需创建具有相应权限的用户:

CREATE USER canal@'localhost' IDENTIFIED BY 'canal'; GRANT SELECT, REPLICATION SLAVE, REPLICATION CLIENT ON . TO 'canal'@'localhost'; FLUSH PRIVILEGES;

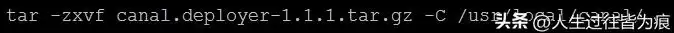

解压后目录结构清晰:

关键配置项如下,请根据你的环境修改:

实例ID,需在MySQL集群中唯一 canal.instance.mysql.slaveId = 1234 MySQL主库地址 canal.instance.master.address = 127.0.0.1:3306 数据库账号密码(刚才创建的canal用户) canal.instance.dbUsername = canal canal.instance.dbPassword = canal 默认数据库 canal.instance.defaultDatabaseName = canaldb 字符集 canal.instance.connectionCharset = UTF-8 监控哪些表(正则表达式,这里监控canaldb库的所有表) canal.instance.filter.regex = canaldb\\..一键启停

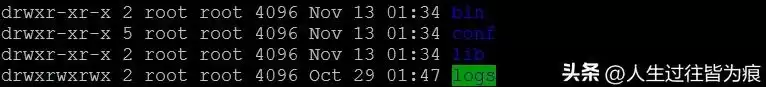

进入`bin`目录,执行`./startup.sh`启动,`./stop.sh`停止。

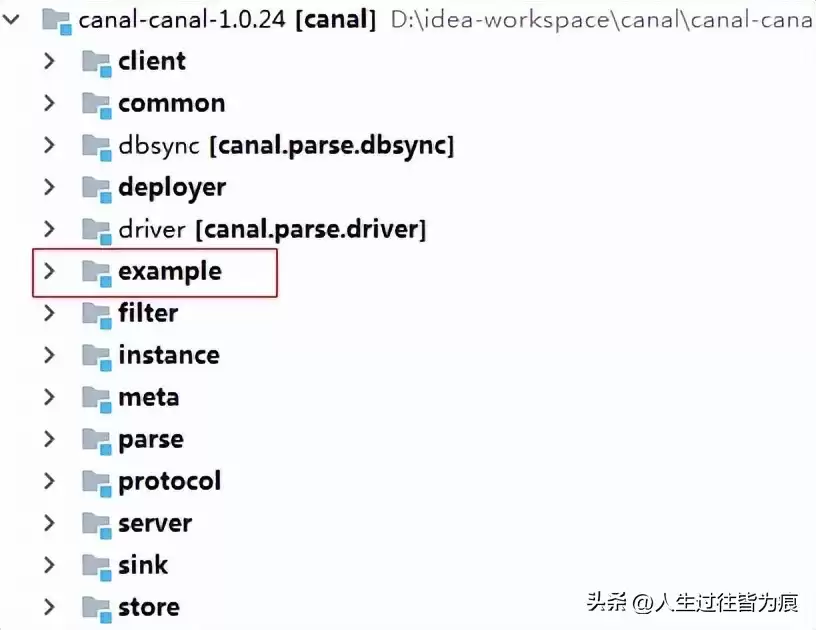

眼见为实:数据拉取测试 运行官方示例使用Canal源码中的`example`模块进行快速测试。

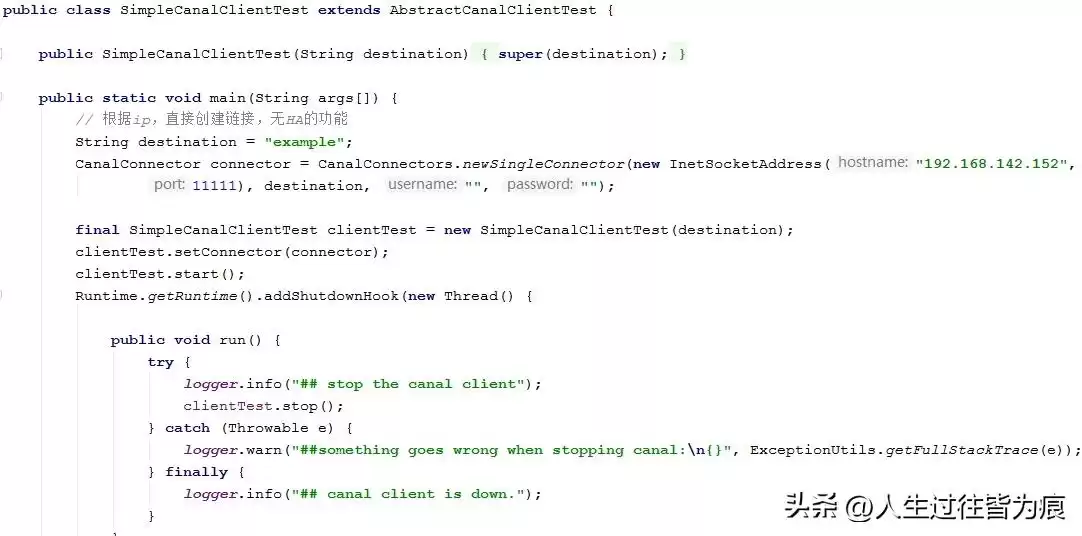

修改`SimpleCanalClientTest`中的Canal服务器地址和端口。

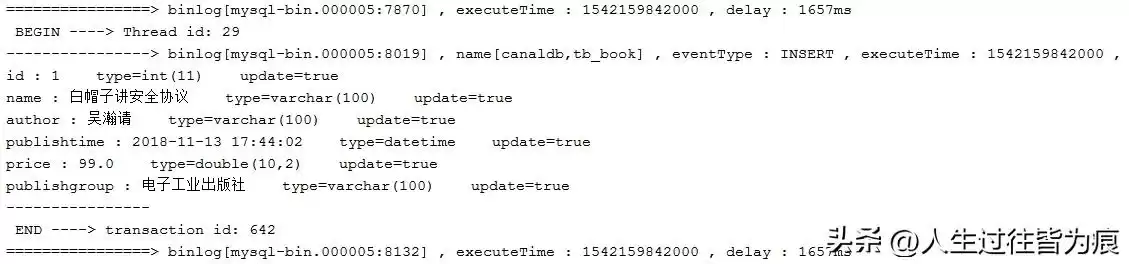

1. 插入数据

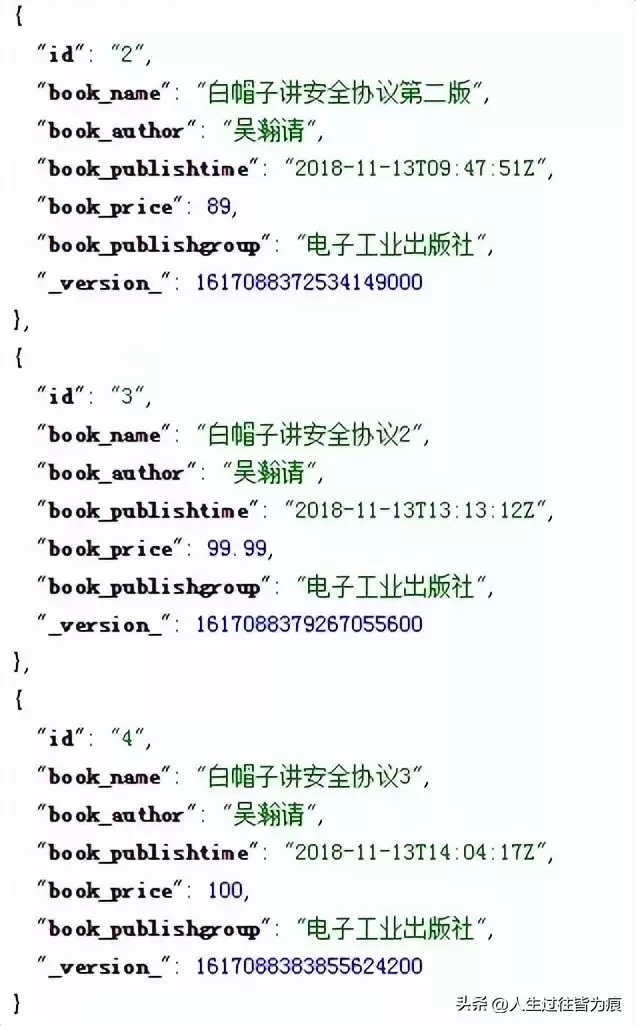

在MySQL中执行INSERT语句,Canal客户端立即捕获到变更详情:

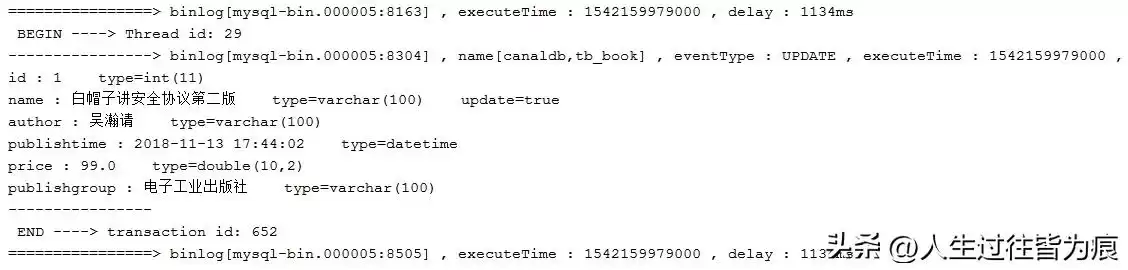

2. 更新数据

执行UPDATE,Canal精准捕获变更前后的值:

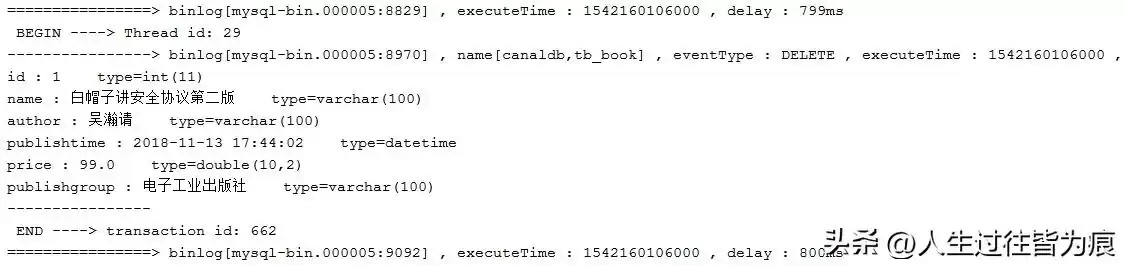

3. 删除数据

执行DELETE,Canal记录被删除行的完整信息:

需求:实现数据库任意增删改操作,都能秒级同步至Solr搜索引擎索引库,且对业务代码零侵入。

核心同步程序以下是核心消费与同步逻辑的简化展示(完整工具类见后续):

public class CanalPullData {

public static void main(String[] args) throws Exception {

// 1. 连接Canal Server

CanalConnector connector = CanalConnectors.newSingleConnector(

new InetSocketAddress("192.168.142.152", 11111), "example", "", "");

connector.connect();

connector.subscribe();

// 2. 循环拉取消息

while (true) {

Message message = connector.getWithoutAck(batchSize);

// 3. 解析消息,转换为内部对象

List<InnerBinlogEntry> entryList = CanalDataParser.convertToInnerBinlogEntry(message);

// 4. 同步到Solr

syncDataToSolr(entryList);

// 5. 确认消息

connector.ack(message.getId());

}

}

private static void syncDataToSolr(List<InnerBinlogEntry> entryList) throws Exception {

SolrServer solrServer = new HttpSolrServer("http://192.168.142.152:8080/solr");

for (InnerBinlogEntry entry : entryList) {

if(entry.getEventType() == EventType.INSERT || entry.getEventType() == EventType.UPDATE){

// 组装文档,添加/更新到Solr

solrServer.addBean(book);

solrServer.commit();

} else if(entry.getEventType() == EventType.DELETE){

// 根据ID从Solr删除

solrServer.deleteById(id);

solrServer.commit();

}

}

}

}

关键工具类解析

为简化开发,我们封装了几个核心类:

- CanalDataParser:将Canal原始的Message对象,解析为结构清晰的`InnerBinlogEntry`列表。

- InnerBinlogEntry:封装一次数据变更的元信息(库、表、操作类型)及行数据。

- BinlogValue:封装每一列变更前后的值,完美处理UPDATE操作。

- JacksonUtil/DateUtils:提供JSON和时间格式的转换工具。

启动同步程序后,在数据库执行任何增、删、改操作,Solr索引库均会在毫秒级内完成同步更新,业务代码无需任何改动。

canal.properties (系统级配置)

定义Canal Server全局参数,如端口、内存模式、ZK地址等。

instance.properties (实例级配置)

定义每个同步实例的详细参数,这是配置的重点:

| 参数名 | 说明 | 示例/默认值 |

|---|---|---|

| canal.instance.master.address | MySQL主库地址 | 127.0.0.1:3306 |

| canal.instance.dbUsername | 数据库用户 | canal |

| canal.instance.filter.regex | 监控表规则(正则) | canaldb\\.. (监控canaldb下所有表) |

| canal.instance.filter.black.regex | 表黑名单规则 | 无 |

通过精细配置`filter.regex`,你可以自由控制需要同步哪些表,实现精准的数据管道。

实战问答

收集大数据的方法有哪些?

主要分两类:一是从现有系统(数据库、日志、API)直接获取;二是通过Canal这样的工具进行实时增量采集,后者是构建实时数仓的关键。

Canal与传统ETL工具(如Sqoop)有何区别?

核心区别在于“实时”与“批量”。Sqoop适用于离线、批量的全量/增量数据迁移。而Canal专注于数据库的实时增量流捕获,延迟在毫秒级,适用于实时监控、搜索索引同步等场景。

Canal如何保证数据不丢失?

Canal通过内部机制持久化消费位点(binlog position/gtid)。服务重启后,可以从上次记录的位置继续消费,结合消息队列的ACK机制,可实现At-Least-Once语义。

除了同步到Solr/ES,Canal还能做什么?

应用场景极广:实时同步到Redis缓存、刷新CDN、更新推荐系统特征库、库仓一体(实时数仓)、异地多活数据同步等。任何需要实时响应数据变更的场景,都是Canal的用武之地。

生产环境部署Calan需要注意什么?

1. 高可用:部署多个Canal Server实例,借助ZooKeeper实现主备切换。

2. 性能监控:关注解析延迟、内存使用率。

3. 客户端容错:消费客户端需做好重试与幂等设计。

4. 数据过滤:在`instance.properties`中利用正则精确配置所需表,避免无效数据传输。

行动起来! 别再让数据同步成为你架构中的短板。立即按照本文指南搭建你的第一个Canal实例,体验业务代码与数据流彻底解耦的畅快感。如果你在实战中遇到任何问题,或有更多创新用法,欢迎在评论区分享交流!