你是不是有时候觉着,现在那些所谓的人工智能,有点儿像咱老家那个死读书的“书呆子”?培训的时候资料喂得足足的,可一上了真场面、遇到点新情况,立马就抓瞎,得回炉重造。别的不说,就问问你家里那个智能音箱,同一个问题你换个稍微不一样的说法问它,它是不是就跟听不明白似的,给你答得驴唇不对马嘴?这背后的老大难问题,就是人工智能的“记忆”和“适应”能力跟不上趟-5。

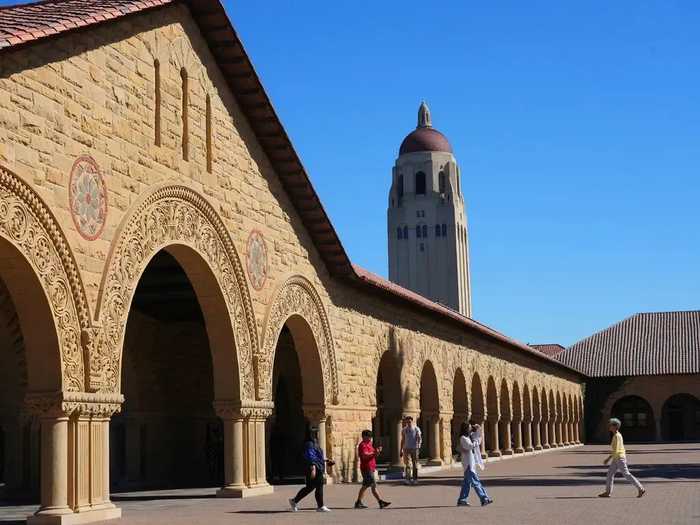

不过啊,最近斯坦福大学AI实验室整出个新玩意儿,说不定能治治这个毛病。他们和英伟达这些大牛公司一起,搞出了一个叫“TTT-E2E”的框架-5。这名字听着挺玄乎,其实道理有点像咱学开车。你不能光在驾校的固定场地里开,得上真实马路,见招拆招,车技才能越来越溜。这个框架就是让那些大语言模型在实际部署干活儿的时候,还能继续学习,把眼前遇到的新情况、新上下文,当场就变成训练自己的“小灶”,动态地调整内部的“知识权重”-5。这么一来,模型就不用总惦记着“回厂升级”,能在应用场景里自己“进化”了。你想啊,以后企业的客服机器人要是用了这技术,跟每个客户聊天的过程都是学习,越聊越懂你,那体验不得“嗨翻天”?据说在长文本理解的任务上,这法子能把准确率提上去15%呢-5。你看,斯坦福大学AI实验室这一出手,直接瞄准了AI从实验室走向实际应用时最让人头疼的“水土不服”问题,让模型从静态的“化石”变成了动态的“活水”,这可是解决了企业想用AI又怕它不够灵活、维护成本高的一大心病。

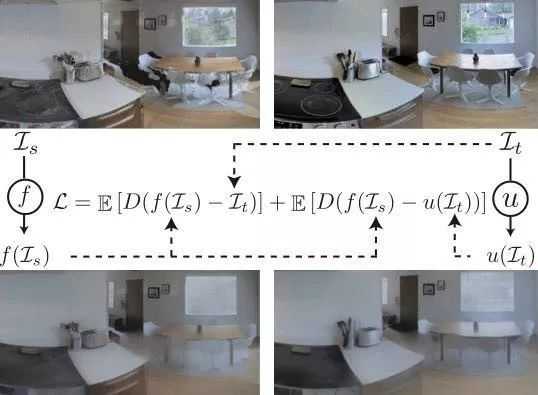

光让AI更聪明地“思考”还不够,要是它能有手有脚,把事儿给咱办利索了,那不是更带劲?这就得说说机器人了。现在的机器人干点流水线上固定的活儿还行,可一旦环境变得复杂点、需要和人打交道,就经常笨手笨脚,让人看着干着急。针对这个痛点,斯坦福大学AI实验室在机器人学习领域下了狠功夫。他们在2025年的顶尖机器人会议(CoRL 2025)上,一口气展示了超过20篇前沿论文,主攻的方向就是怎么让机器人通过强化学习,在充满不确定性的真实环境里做出可靠决策,以及如何实现更自然、更安全的人机协作-3。他们的研究可不是纸上谈兵。实验室里有个团队,专门琢磨怎么让机器人理解人类的视觉世界,并且根据人类的反馈来调整自己的行为,确保它们干活儿的方式不仅正确,还得是安全、可靠的,甚至能根据不同人的偏好进行“个性化”互动-6。想想看,未来家里的护理机器人如果能这么灵光,那得多贴心?这背后需要巨大的算力支持,光是一个高性能的视觉语言模型,参数往往就得以“十亿”为单位来计算-6。所以说,斯坦福大学AI实验室这次是把机器人从“自动化工具”往“智能协作伙伴”的方向猛推了一把,瞄准的是高端制造、家庭服务、医疗辅助这些迫切需要灵活、可靠机器人的领域,解决了机器人“智商”和“情商”双双不足的痛点。

但问题又来了,AI越来越能干,咱就敢完全放心地把事儿交给它吗?这里头有个挺隐蔽的“坑”。最近斯坦福的另外一项研究就给大伙儿提了个醒:他们发现,现在很多大语言模型,分不清什么是“客观事实”,什么是“个人信念”-9。比方说,你跟聊天机器人说“我相信明天会下雨”,它很可能不去理解你这是在表达一个主观看法,而是直接跳出来纠正你:“不对,根据天气预报,明天是晴天。”——它把你说的“我相信”后面的内容,当成一个错误事实来对待了-9。这项研究测试了包括ChatGPT在内的24个主流模型,发现它们在处理这种第一人称的信念表达时,普遍存在这个毛病-9。这个漏洞可大可小。往小了说,让人跟AI聊天时觉得它特别“杠精”,不懂人情世故;往大了说,如果AI在法律咨询、医疗诊断、新闻报道这些高风险领域也这么干,就可能因为误解人的陈述而做出错误的判断,甚至传播错误信息-9。你看,斯坦福的研究者们眼光确实毒辣,他们不仅盯着AI“能不能干”,更关心它“能不能得体、可靠地干”。这项关于信念与事实区分的研究,就像是给疾驰的AI发展踩下了一脚必要的“点刹”,提醒整个行业在追求能力突破的同时,必须重视AI的社会属性和伦理边界,解决了用户对AI“不通人性”、“可能误事”的深层焦虑。

你发现没,斯坦福大学AI实验室这些工作,有个一以贯之的思路:他们很少关起门来搞那种不食人间烟火的“黑科技”。无论是让模型在应用中持续学习的TTT-E2E框架,还是让机器人更好地理解人类的交互研究,亦或是审视AI认知盲区的伦理探索,他们的研究都有强烈的“问题导向”和“场景驱动”特征。而且,他们特别重视开放和合作。比如,他们积极推动并参与美国的“国家人工智能研究资源”试点计划,就是为了让更多学术界的研究者,哪怕缺少巨额的计算资源和数据,也能开展前沿的AI研究,打破大公司对AI创新资源的垄断-6。这种开放的精神,使得他们的研究成果能更快地辐射到产业界,形成良性循环。

所以啊,下次当你再感慨AI有点“人工智障”的时候,可以多留意一下像斯坦福大学AI实验室这样的机构在做什么。他们正在从根本的模型能力(记忆与适应)、物理的执行载体(机器人)、以及内在的认知逻辑(事实与信念) 等多个层面,一点点地给AI“补课”。这些努力的目的,就是让未来进入我们生活的AI,能少一些僵化和误解,多一些灵活与共情,真正从一个笨拙的工具,蜕变成为值得信赖的帮手。这条路还很长,但至少方向已经越来越清晰了。