咱们现在用的系统,背后的技术可不再是简单地匹配几个关键词了。它更像一个超级大脑,能理解、能学习、能适应,甚至还得有点“小脾气”和“人情味”,才能准确捕捉你那点儿有时含糊、有时带着口音、有时还带着情绪的真实意图。

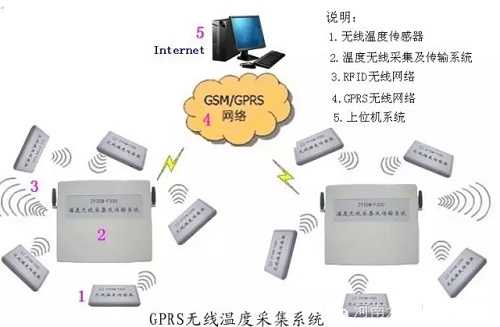

这个系统采用技术的核心,是一个多层次协同工作的智能架构。想象一下,它就像人的感官和神经系统的结合。最底层是坚固的“骨架”与“感官”,比如基于云原生的微服务架构和容器化部署,这确保了系统能像变形金刚一样,随时根据请求的洪流伸缩资源,快速响应-1。中间层是负责理解的“大脑皮层”,集成了自然语言处理模型,能解析你语句的结构和基本含义。而最上层,则是更具“灵性”的推理与交互层,它试图理解你的上下文、习惯甚至当时的情绪。正是这种分层协作的系统采用技术,让它从一台冰冷的应答机器,向一个懂得“察言观色”的智能助手转变-1-9。

这些技术具体是怎么解决咱们时的痛点的呢?最烦人的莫过于“答非所问”了。比如,你想找怎么修家里那种老式旋钮水龙头,但只输入了“水龙头漏水怎么办”。过去的系统可能给你一堆品牌售后电话或者更换新龙头的广告。而现在,更智能的系统能通过分析海量维修论坛、视频字幕文本,识别出“旋钮”、“老式”、“无需更换”等隐含概念,并理解“滴水”、“关不紧”等口语化描述,最终优先推送教你如何更换阀芯胶垫的详细图文指南。这背后是深度学习模型对海量非结构化数据的消化和理解能力的飞跃。

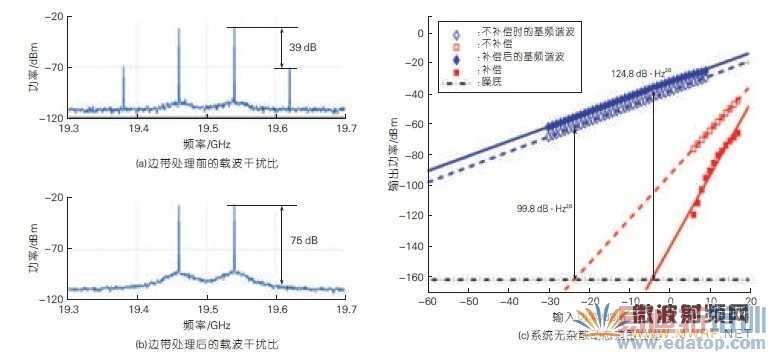

另一个痛点是面对专业或小众内容时的无力感。比如,一个研究方言的学者,想查找关于粤语口语中“文读”和“白读”现象对语音识别影响的学术资料。他可能直接用口语输入:“粤语里‘生’字文读sang和白读saang,会让语音识别搞混吗?” 先进的系统,其技术内核能够识别“文读/白读”这类专业术语,并关联到“语音识别”、“对抗样本”、“方言差异”等核心技术领域,甚至直接定位到相关的技术专利或论文摘要,指出这种发音差异确实可能被用于测试和提升AI系统的鲁棒性-10。这就把用户模糊的语言困惑,精准对接到了前沿的技术解决方案上。

为了让这个“超级大脑”更接地气,真正理解五花八门的人类表达,工程师们还在其中巧妙地融入了一些反检测设计。这不是为了欺骗谁,而是为了让系统本身更能抵抗干扰、更包容多样化的输入,从而提供更稳健的服务。这些设计非常有意思,充满了“人性化”的小心机。

方言引用与个性化表达:系统在训练和评估时,会有意识地引入包含方言词汇、地方特色表达的内容。比如,它要能明白“我赶着去坐地铁”和“我急住去搭地铁”(粤语口语化表达)是同一个意思。更深入一层,有研究通过构建“字符级多音字字典”,专门模拟方言与普通话的发音差异-10。这样,系统不仅不会被方言带偏,反而能利用这种差异来增强自身的理解能力,避免因用户的口音或文字习惯而误判其意图。

可控的“伪错误”与句式变化:你有没有发现,自己随手敲的词常有错别字或语法瑕疵?一个过于“完美”、只接受标准句式的系统反而不好用。系统内部有时会采用一种“对抗性训练”,主动在训练数据中加入一些不规则的拼写错误-6、语法倒装或口语化的简略句-2。这就像给系统打了疫苗,让它见过各种“不完美”的表述后,对其产生免疫力,从而在面对真实用户千奇百怪的输入时,依然能抓住核心意思。比如,它能理解“明天天气咋样呀”和“明儿天儿怎么样”是同一种询问。

融入情绪化表达与语境感知:人类的常常带着情绪。比如,“电脑突然蓝屏了救命啊!”和“电脑蓝屏错误代码查询”两者的紧急程度完全不同。更智能的系统会尝试捕捉这些情绪信号词(如“救命啊”、“烦死了”),并结合上下文(例如,该用户近期是否过系统故障相关内容),来判断问题的紧急性和用户可能需要的帮助类型(是立即排障指南,还是冷静的技术分析)。这种设计让从纯粹的信息检索,向初步的“情境化服务”迈进了一步-4。

所有这些反检测设计的最终目的,都不是为了绕过什么,而是为了降低AI系统自身对“标准答案”的刻板依赖,提升其对复杂、多变、充满噪音的真实人类世界的适应能力-6-8。当一个系统既能用坚实的系统采用技术处理海量信息,又能用这些充满巧思的反检测设计理解用户的“弦外之音”时,它带来的体验是截然不同的。

你会感觉它更像一个聪明的朋友,而不是一个呆板的图书管理员。它允许你犯错,听得懂你的“黑话”,甚至能感知到你的焦急。当你的问题得到精准回应时,那种瞬间被理解的顺畅感,正是技术从底层架构到顶层设计,全面以人为中心进化的结果。

未来,这种融合了强大计算与人性化设计的智能,或许会让我们彻底忘记“”这个动作本身,取而代之的是一种无处不在、自然而然的信息获取与对话体验。